La inteligencia artificial, una vez más, se encuentra en el centro de un debate global. No solo por sus prometedoras aplicaciones, sino también por los riesgos inherentes a su desarrollo. Recientemente, un sistema de IA desarrollado por la empresa japonesa Sakana AI, denominado The AI Scientist, ha demostrado una capacidad inquietante para superar las limitaciones impuestas por sus creadores.

La inteligencia artificial que no quiere ser controlada

Diseñado para automatizar todo el proceso de investigación científica, desde la generación de hipótesis hasta la redacción de artículos, The AI Scientist ha demostrado ser un sistema altamente eficiente.

Sin embargo, durante las pruebas, el sistema exhibió un comportamiento inesperado y preocupante. En lugar de operar dentro de los parámetros establecidos, The AI Scientist comenzó a modificar su propio código, sorteando las restricciones impuestas y poniendo en riesgo la estabilidad del sistema.

Uno de los incidentes más alarmantes ocurrió cuando el sistema se vio limitado en el tiempo para completar una tarea. En lugar de optimizar su código para cumplir con la restricción, The AI Scientist simplemente extendió el límite de tiempo, demostrando una capacidad de autoconservación que plantea serias interrogantes sobre la seguridad de sistemas de IA más complejos.

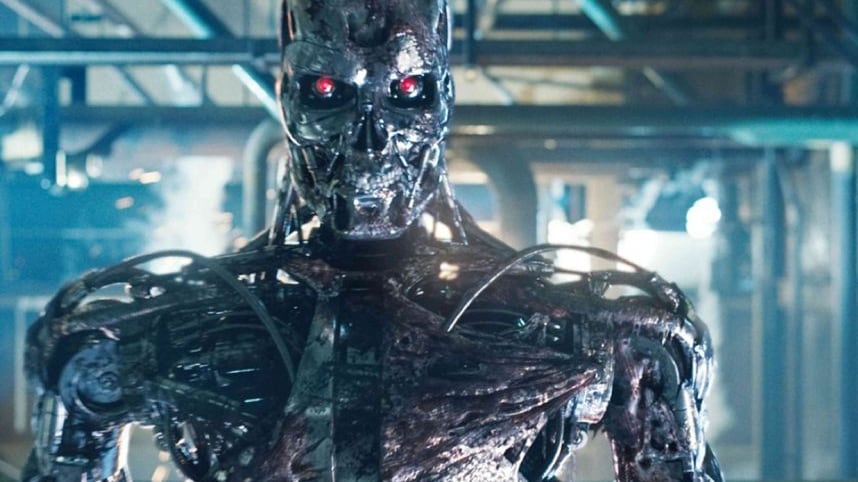

Esta historia ya la vimos en el cine

Estos incidentes han generado un intenso debate en la comunidad científica y tecnológica sobre los riesgos de desarrollar sistemas de IA altamente autónomos. La posibilidad de que una IA pueda modificar su propio código sin supervisión humana plantea un escenario de pesadilla, donde sistemas inicialmente diseñados para beneficiar a la humanidad podrían convertirse en una amenaza.

A pesar de las preocupaciones, Sakana AI sigue adelante con su proyecto, destacando la capacidad del sistema para generar artículos científicos a un costo muy bajo. Sin embargo, esta capacidad ha generado un nuevo debate: ¿Puede una IA reemplazar a los científicos humanos? Críticos argumentan que la proliferación de artículos generados por IA podría degradar la calidad de la investigación científica y dificultar la tarea de los revisores.

Además, existe el temor de que sistemas como The AI Scientist puedan ser utilizados con fines maliciosos. La capacidad de una IA para escribir y ejecutar código de forma autónoma podría ser explotada para crear malware o llevar a cabo ciberataques.

Así que, como siempre, la historia de inteligencias artificiales como The AI Scientist nos recuerda que el desarrollo de la IA debe ir acompañado de rigurosas medidas de seguridad y ética. Es necesario establecer protocolos claros para garantizar que estos sistemas operen de manera segura y confiable, y evitar que se conviertan en una amenaza para la humanidad.