El ‘deepfake’ se ha convertido en una de las técnicas favoritas de los ciberdelincuentes, que la utilizan cada vez con más frecuencia para cometer fraude financiero, espionaje industrial y para extorsionar a través de redes sociales a otros usuarios, ya sean anónimos o famosos, y dañar su reputación.

PUBLICIDAD

Esto consiste en suplantar la identidad de otra persona en un vídeo (ya sea modificando su rostro o su voz) utilizando para ello Inteligencia Artificial, de forma que el resultado parezca original y real.

Te recomendamos: Inteligencia Artificial es una amenaza equiparable a “una guerra nuclear”

De ese modo, utilizando redes neuronales y el denominado aprendizaje profundo, los ciberdelincuentes pueden difundir información falsa o maliciosa, así como estafar a usuarios, empresas e instituciones.

Recomendados

The Line: revelan nuevas imágenes de la megaciudad que construyen en un desierto de Arabia Saudita

¿Por qué Elon Musk despidió a su equipo estrella de Tesla y aún así los inversores aplauden?

Así puedes crear tu propia encuesta en Instagram: ¿Sabías que ahora puedes votar en el feed?

Según varias organizaciones, entre ellas el Foro Económico Mundial (WEF, por sus siglas en inglés), la cantidad de ‘deepfakes’ en línea aumentó en los últimos años, hasta alcanzar una tasa anual de un 900%, según este último.

Para conocer cuáles son las tendencias de los ciberdelincuentes en este ámbito, los investigadores de Kaspersky han realizado una clasificación que recoge las tres amenazas ‘deepfake’ más peligrosas de 2023.

La primera de ellas es el fraude financiero. En este caso, los ciberdelincuentes utilizan el ‘deepfake’ para hacerse pasar por personajes famosos, a fin de que los usuarios caigan en el engaño y crean lo que están viendo y escuchando.

Para ello, los estafadores utilizan imágenes de celebridades o mezclan antiguos vídeos y hacen que parezcan actuales. Asimismo, lanzan transmisiones en directo en redes sociales con la promesa de duplicar cualquier pago en criptomonedas que se les envíe.

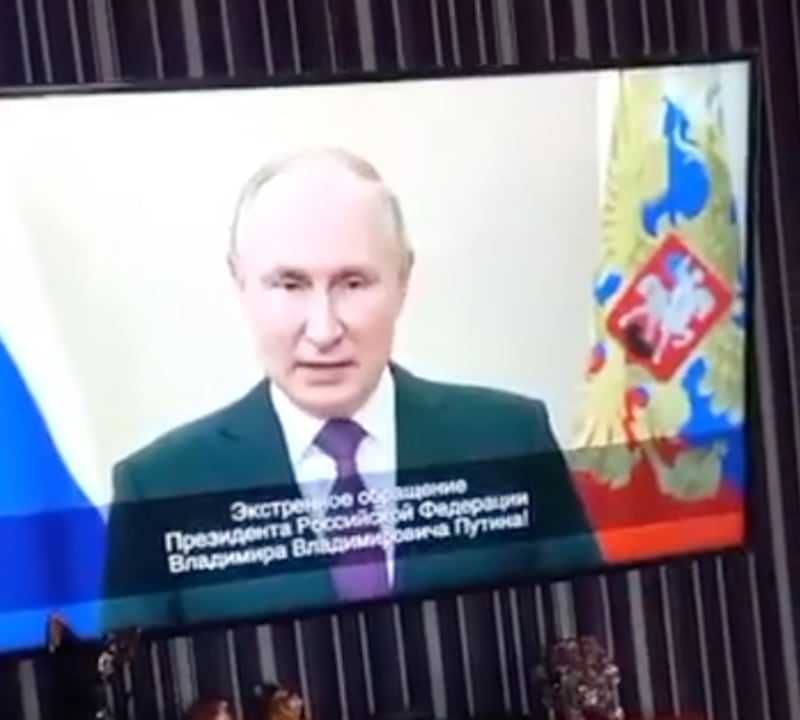

Ejemplo de este ‘deepfake’ es un vídeo creado por IA hace poco, en el que el presidente de Rusia, Vladimir Putin, transmitió un discurso falso sobre la evacuación en las regiones de Kursk, Belgorod y Briansk, en la frontera con Ucrania. El vídeo fue viral y provocó dudas sobre su veracidad.

#ICYMI A raíz de un ciberataque, varias cadenas transmitieron un discurso falso del presidente ruso, realizado con “deepfake” sobre la evacuación en las regiones de Kursk, Belgorod y Briansk, en la frontera con Ucrania.https://t.co/AQrvu6kHSwpic.twitter.com/Lxku9zXUP0

— Raúl León (@rleon_mx) June 6, 2023

Suplantación de identidad de personas famosas

Los famosos también son el objetivo de los ciberdelincuentes cuando se trata de emplear ‘deepfakes’ pornográficos, puesto que con una sola foto de una persona se puede crear un vídeo íntimo como si fuera esa persona la que lo estuviese haciendo.

En este caso, los ciberdelincuentes emplean esta técnica para extorsionar y chantajear a sus víctimas, así como dañar su reputación, que también pueden ser anónimas.

Desde la compañía de ciberseguridad también han comentado que este formato puede suponer un riesgo para las empresas, ya que no solo se puede utilizar para coaccionarlos, sino también para promover el espionaje industrial.

Tanto es así que se dio el caso de que los ciberdelincuentes engañaron al gerente de un banco de Emiratos Árabes Unidos, a quien robaron 35 millones de dólares. Para ello, utilizaron una grabación de voz con una locución falsa que le convenció para hacerlo.

Otro caso fue el de los ciberdelincuentes que generaron un ‘deepfake’ de uno de los directivos de la plataforma de criptomonedas Binance, a quien suplantaron en una reunión ‘online’ en la que se habló en nombre del ejecutivo.

¿Cómo evitar ser víctima de estas estadas?

Para evitar este tipo de fraudes, la compañía recomienda a los usuarios revisar las prácicas de seguridad en la empresa para estar al tanto de las últimas amenazas, así como crear un ‘muro humano’ informando a los empleados sobre esta técnica.

También es conveniente utilizar fuentes de información fiables, en las que inicialmente no habría espacio para este tipo de ataques con IA. Por último, se deben tener en cuentas características que puedan indicar que un vídeo es falso, como son los movimientos bruscos o los cambios de iluminación.